在 COMPUTEX 2025 開幕前夕,Intel 宣布推出兩款全新專業 GPU:Arc Pro B50 與 Arc Pro B60 。這兩款產品定位於 AI 推論加速與工作站級專業圖形領域,其中 Arc Pro B50 屬於小型主流工作站升級方案,而 Arc Pro B60 則強調高性能與擴充性,可用於本機端跑大型 AI 模型推論。

這代表 Intel 擴充 Arc Pro 顯示卡系列至 AI 應用場景,企圖在現有 GPU 市場版圖中挑戰現狀。

本文目錄

Arc Pro B50:半高卡設計、 16GB 記憶體瞄準主流工作站

Arc Pro B50 是一款半高半長 (Half-Height, Half-Length) 的顯示卡,擁有 16GB GDDR6 顯示記憶體。得益於 128 個 XMX 矩陣運算引擎,B50 採用 PCIe Gen5 介面,可提供高達 170 TOPS 的 INT8 推論運算性能。這款 GPU 專為小型工作站設計,能輕鬆安裝於各類空間有限的桌機電腦中。

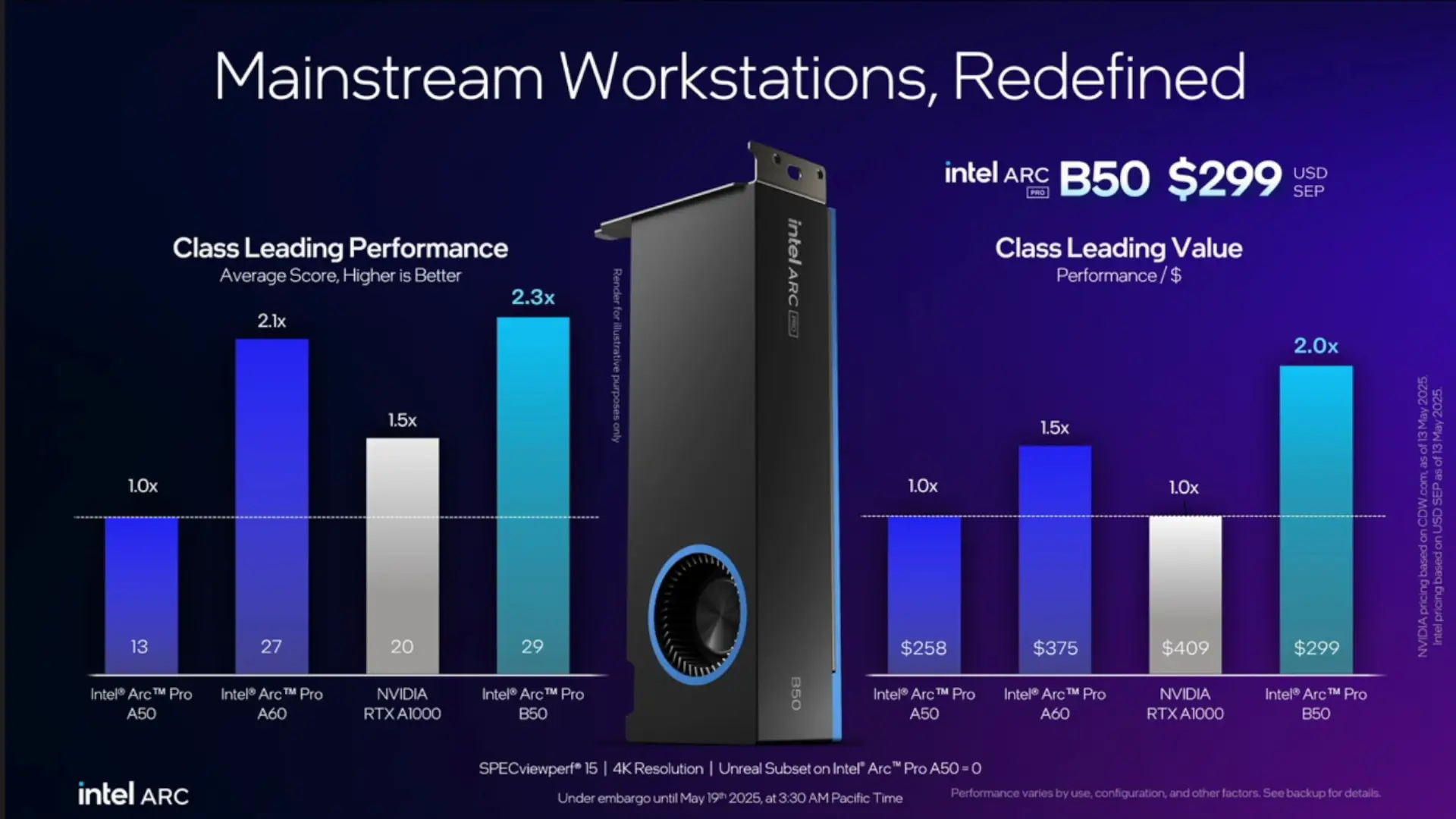

面對建築、工程、設計等專業領域日益龐大的模型與圖形工作負載,Arc Pro B50 提供了更充裕的顯示記憶體與 AI 加速能力。 Intel 指出,16GB 記憶體容量是前代 Arc Pro A50 的 2.7 倍,亦為同級競爭對手 NVIDIA RTX A1000 的 2 倍。

最佳化專業驅動程式之後,B50 在常見專業應用上的效能,比前代產品提升了約 2.3 倍,同時效率提高 2.4 倍。相較之下,在部分 AI 推論和即時視覺化任務中,新款甚至達到前代產品 3 倍以上的速度。此外,Arc Pro B50 將提供經 ISV(獨立軟體廠商)認證的專業級驅動,確保與主流設計和工程軟體的相容性與穩定性。這意味著專業用戶在使用如 CAD 、 3D 建模等軟體時,可獲得可靠的性能表現與定期更新的驅動支援。

Arc Pro B60:24GB 顯示記憶體,支援 LLM 推論與多卡擴充

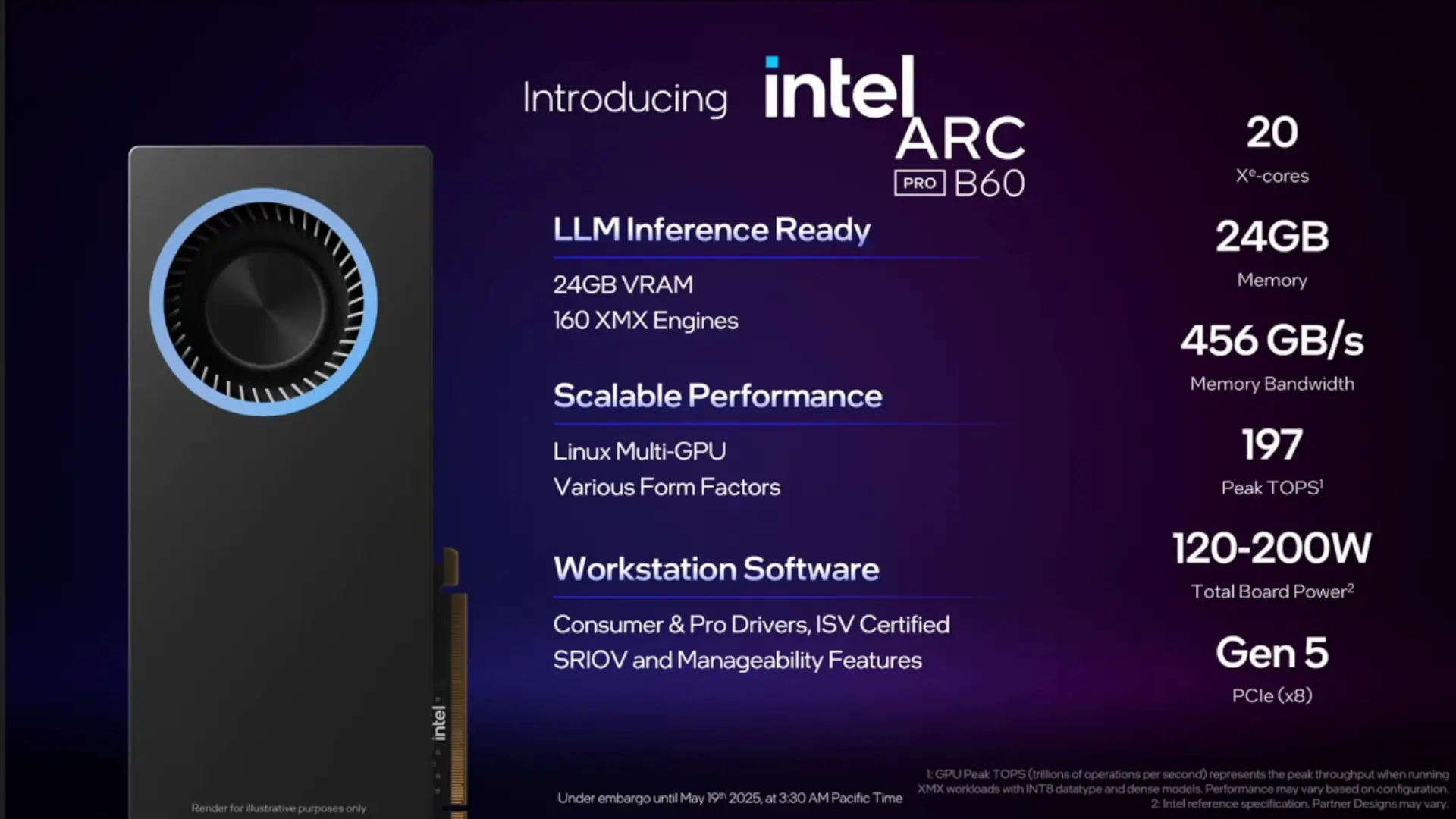

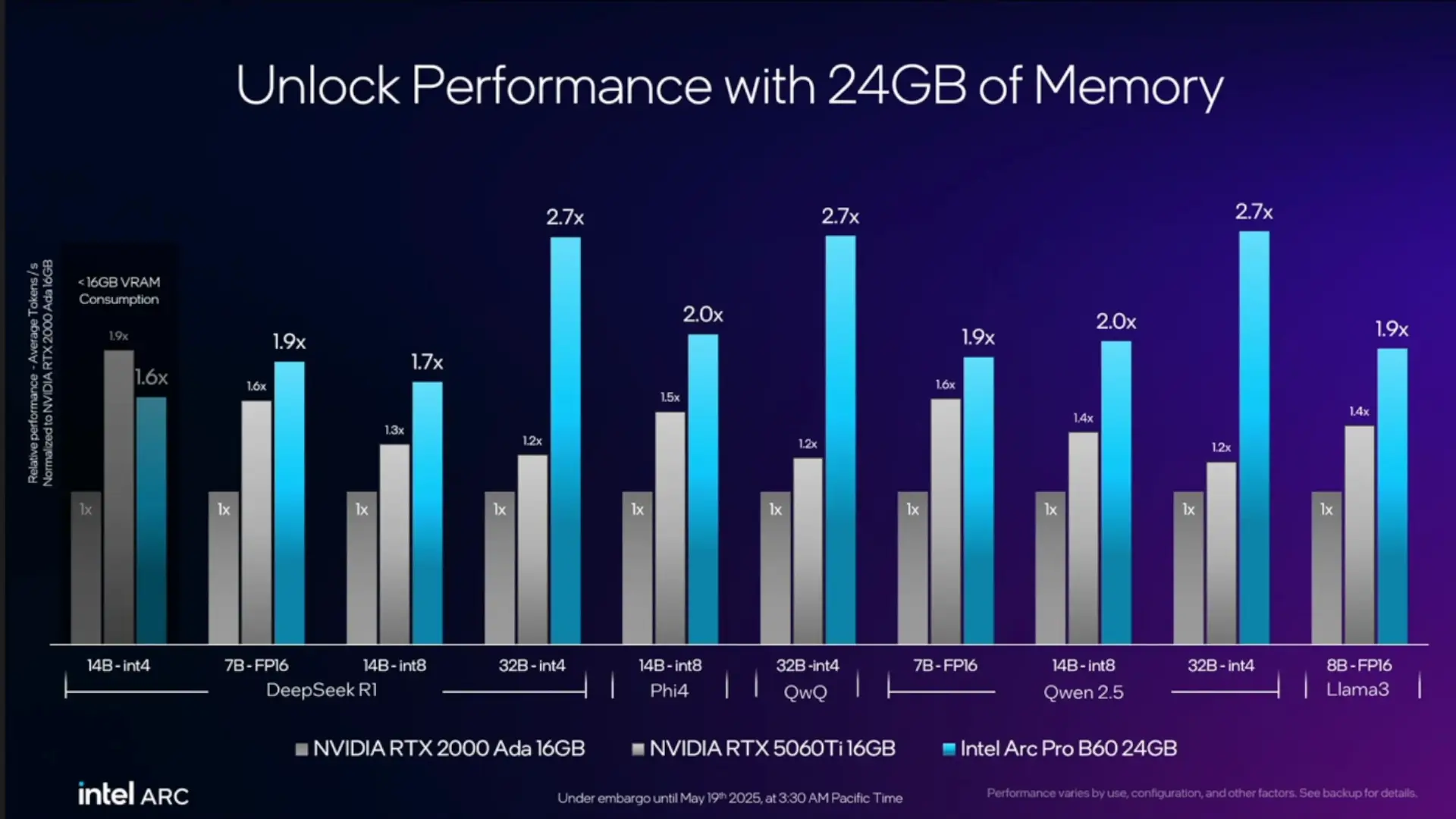

Arc Pro B60 則定位為高階且可擴充的旗艦級 GPU,專門針對本機端的 AI 推論工作負載所設計,配備 24GB GDDR6 顯示記憶體和 160 個 XMX 引擎,INT8 運算性能高達 197 TOPS 。相較於 B50,B60 的記憶體頻寬多出一倍,達到 456 GB/s 。如此規格使 B60 能夠勝任大語言模型推論所需的資料傳輸量和運算需求,將最新的大型語言模型能力導入本機端環境。

Arc Pro B60 的特色是能夠支援多顆 GPU 協同運作,擴充運算效能和記憶體容量。在 Linux 平台下,使用者可以透過多張 B60 架一個推論系統,累加顯示記憶體以處理更龐大的模型。例如,兩張 B60(合計 48GB 顯示記憶體)可容納大約 320 億參數的模型推論,加上對應的 KV 快取和上下文記憶體後仍能流暢執行,而單卡 24GB 顯示記憶體,在此情境下會因記憶體不足而需要頻繁存取系統記憶體,導致性能大幅下降。

隨著 GPU 數量增加,系統總顯示記憶體可達 96GB(四卡)甚至 192GB(八卡),可對應更長的上下文窗口,同時處理更多的使用者詢問。 Intel 表示 24GB 記憶體是現階段在本機端進行 AI 推論的甜蜜點,能夠處理約 70 億參數以上的模型,而透過雙卡或多卡擴充則可進一步勝任更高參數量模型或更多用戶的同時推論需求。

B60 在硬體設計上亦考慮了彈性與多樣性。 Intel 允許合作夥伴開發各種外形的 B60 產品,包括單風扇、無風扇甚至雙 GPU 合載的板卡設計,以滿足不同市場需求。針對企業級應用,Intel 計畫在今年底以前為 B60 增加 SR-IOV(單根 I/O 虛擬化)功能及遠距管理等特性。再加上每季更新的專業驅動與 AI 軟體最佳化,Arc Pro B60 希望能夠成為一款本機端 AI 推論的全能型 GPU 方案。

Arc Pro 系列延伸應用場景:從工作站到企業推論與邊緣市場

Arc Pro B50 與 B60 同屬 Intel Arc Pro 系列專業 GPU 家族。該系列最初聚焦於圖形工作站市場,如內容創作、 CAD 工程等,強調穩定可靠的專業驅動和軟體認證。 Intel 此次藉由 B50/B60 的發表,宣示了 Arc Pro 產品線向 AI 領域的積極延伸。

官方表示,Arc Pro 系列正從傳統的繪圖工作站跨到至推論工作站 (Inference Workstation),以滿足企業用戶在本機執行 AI 推論的需求。 B50 與 B60 的推出,可被視為 Intel 為企業級 AI 推論工作站市場量身打造的解決方案,而 Intel 亦計畫在今年稍晚進一步推出針對邊緣運算 (Edge Computing) 的 Arc Pro 變體,以完善其產品布局。

為確保專業應用的相容與穩定,Intel 持續與獨立軟體廠商合作,提供超過 50 款以上經認證的應用軟體,並透過每季更新驅動程式來最佳化工作站流程。值得一提的是,Intel 正為 Arc Pro 系列導入對 Linux 作業系統的驗證支援,並最佳化 AI 加速的驅動程式。這表示未來 B50 和 B60 在 Linux 環境下的表現將獲得官方保障,同時也會加強深度學習框架等軟體的支持,方便開發者在 Intel GPU 上執行各種 AI 工作負載。整體來看,Arc Pro 系列的策略反映出 Intel 希望在專業繪圖與 AI 推論兩方面同時發力,進軍更多元的企業與邊緣計算市場。

容器化 AI 平台「Project Battle Matrix」:多 GPU 部署與 LLM 最佳化

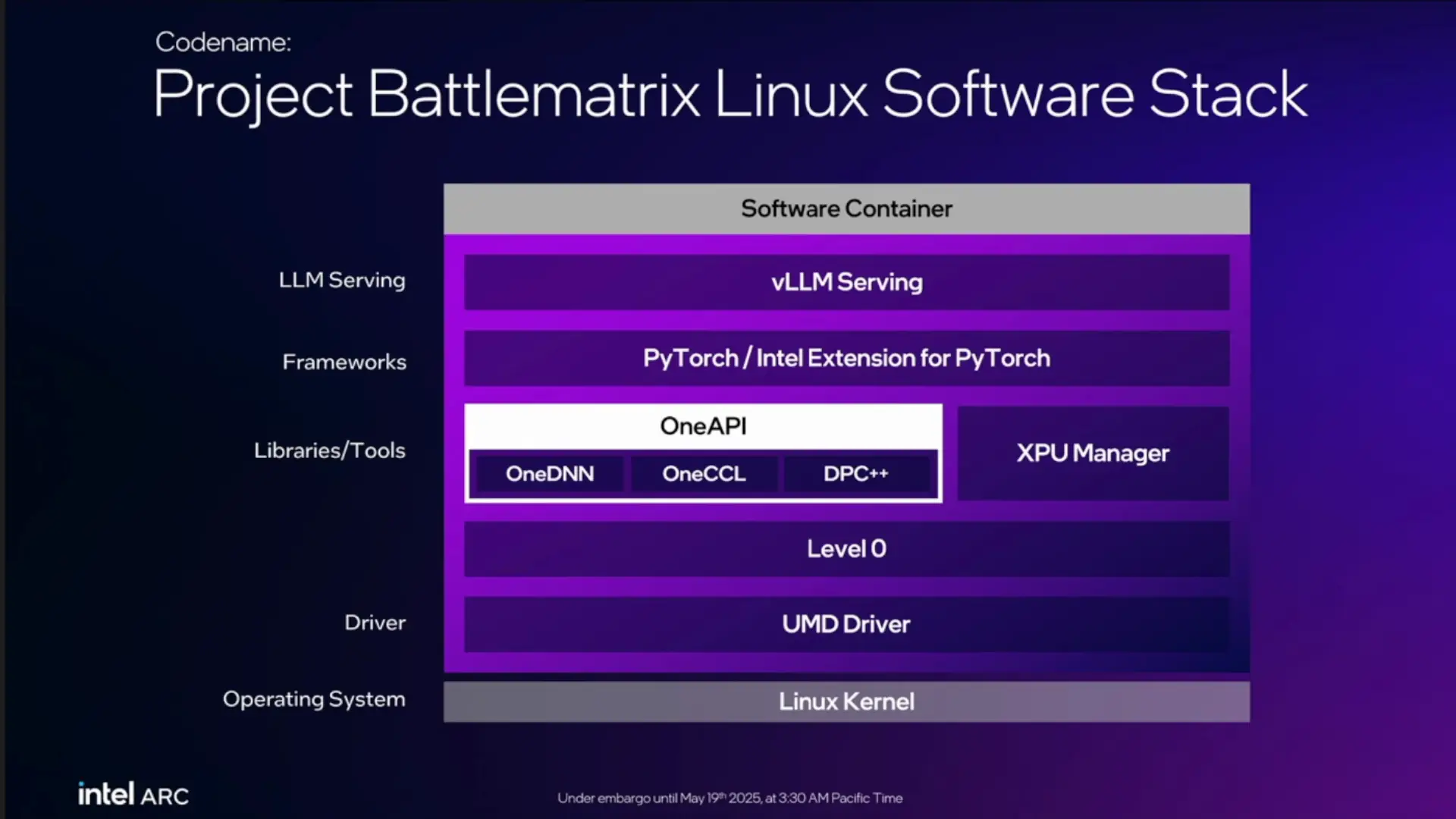

除了硬體產品,Intel 還發布了名為「Project Battle Matrix」的推論工作站平台方案。這是一個專為本機 AI 推論打造的軟硬體整合平台,可在單一系統中支持最多 8 張 Arc Pro GPU 同時運作,合計提供高達 192GB 的顯示記憶體資源。如此配置允許使用者在標準 PCIe Gen5 架構的 Xeon 工作站上執行規模達 700 億參數級別的 AI 模型,相當於過去只能在大型資料中心才能執行的模型,如今可透過成本較低的本機工作站來實現。

Project Battle Matrix 強調以容器化方式交付軟體環境,以簡化 AI 推論部署並確保軟體相依性的穩定。 Intel 提供預先設定好的容器映像檔,內含經驗證的驅動程式、 AI 函式庫、開發工具以及最佳化過的大型語言模型推論框架。使用者只需在支援的平台上部署該容器,即可獲得一套完整的 AI 推論堆疊 (stack),而無須逐一安裝配置底層軟體。這套解決方案特別針對 LLM 進行最佳化測試,涵蓋了從底層 GPU 驅動程式到頂層模型的全堆疊整合。

按照 Intel 的路線圖,Project Battle Matrix 的容器方案將分階段推出並逐步增強功能。在 2025 年第三季,Intel 計畫發布第一版經最佳化的 LLM 推論容器,內建開原項目如 vLLM 等模型服務框架,並提供 GPU 遠端監控等基礎功能。隨後在第四季,容器將加入 SR-IOV 支援、虛擬桌面環境及進階管理工具等企業級特性。透過這種漸進式的軟體更新,Intel 希望為使用其 GPU 進行 AI 推論的客戶提供持續提升的體驗,同時降低部署複雜度。

大容量顯示記憶體與價格策略並舉,軟體生態仍待觀察

Intel 此次發表 Arc Pro B50/B60,顯示出其以大容量顯示記憶體搭配積極定價策略來搶攻 AI 推論市場的企圖心。 B50 提供遠勝同級對手的 16GB 顯示記憶體,讓專業用戶能夠處理更大型的工程項目或資料集,而售價預計將落在數百美元等級,以取得優異的每美元性能表現。

雖然高階的 B60 沒有統一定價,由各板卡廠商自行定價,但 Intel 預估單卡價格約為 500 美元。相比動輒數千美元的資料中心級 GPU,用多張 B60 組建本機推論伺服器可說是具備相當的成本優勢。 Intel 預期搭載 B60 的完整系統價格區間約在 5,000 至 10,000 美元。若 B60 最終每卡售價真能落在 500 美元上下,將對現有推論 GPU 市場形成頗具競爭力的衝擊。對於預算有限但有本機 AI 需求的中小企業而言,購買多張 B60 自行架設推論工作站,有望成為在控制成本同時掌握資料主權的一條出路。

儘管硬體規格和價格策略令人矚目,Intel 在軟體相容性與生態系統方面仍面臨考驗。目前 AI 開發社群對 NVIDIA CUDA 生態系統的依賴根深蒂固,各種深度學習框架和工具均對 NVIDIA GPU 進行最成熟的最佳化。而 Intel Arc GPU 作為新進競爭者,需要時間建立起同等完善的軟體支持。

從專業應用角度來看,Intel 已經投入資源與 ISV 合作,確保 Arc Pro 對主要工作站軟體的相容性;在 AI 領域,Intel 也發布了 oneAPI 工具包並推行 OpenVINO 等加速庫來吸引開發者。然而,生態系統的培養非一朝一夕可成。 Intel 此次特別強調了軟體堆疊與開發者生態的建設,將之視為長期 GPU AI 策略的重要一環。