在 2025 年台灣半導體展 (Semicon) 期間,Arm 宣布正式推出名為 Lumex 的運算子系統平台 (Compute Subsystem, CSS) 。這項平台被定位為支撐旗艦智慧型手機與新一代個人電腦的基礎架構,並且首次全面整合第二代 Scalable Matrix Extension(SME2) 指令集。 Arm 希望透過這樣的設計,讓合作夥伴能夠更快開發出具備 AI 能力的裝置,同時縮短產品上市的時間。

Arm 應用工程總監徐達勇表示「AI 的發展在我有生之年都看不到終點」,而人們對於未來的行動裝置將有即時回應、隱私保護與節能效率三大要求,意味著個人運用 AI 技術,將有很大一部分從雲端遷移到行動裝置上。

「算力是所有 AI 運算的基礎,Arm Lumex CSS 是專為 AI 運算打造的行動運算平台,」徐達勇表示:「透過 Arm Lumex,我們能夠將桌面端的運算體驗帶到行動裝置端。」

他強調,SME2 技術未來將全面佈局到所有 Arm CPU 平台,並預估到 2030 年,將有超過 30 億台裝置支援 SME 或 SME2 指令集,為全球帶來超過 100 億 TOPS 的運算效能。這個數字意味著 Arm 正試圖透過平台化的方式,在 AI 發展浪潮中占據核心位置。

本文目錄

Lumex CSS 平台架構與創新

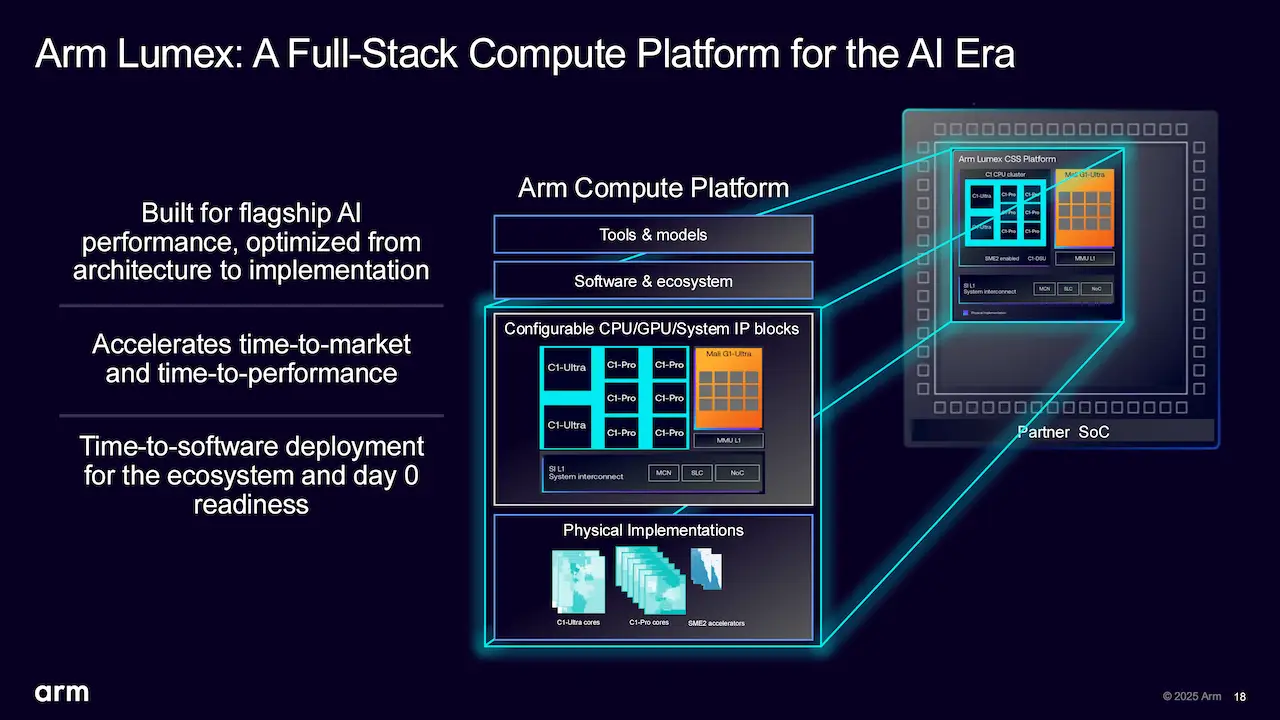

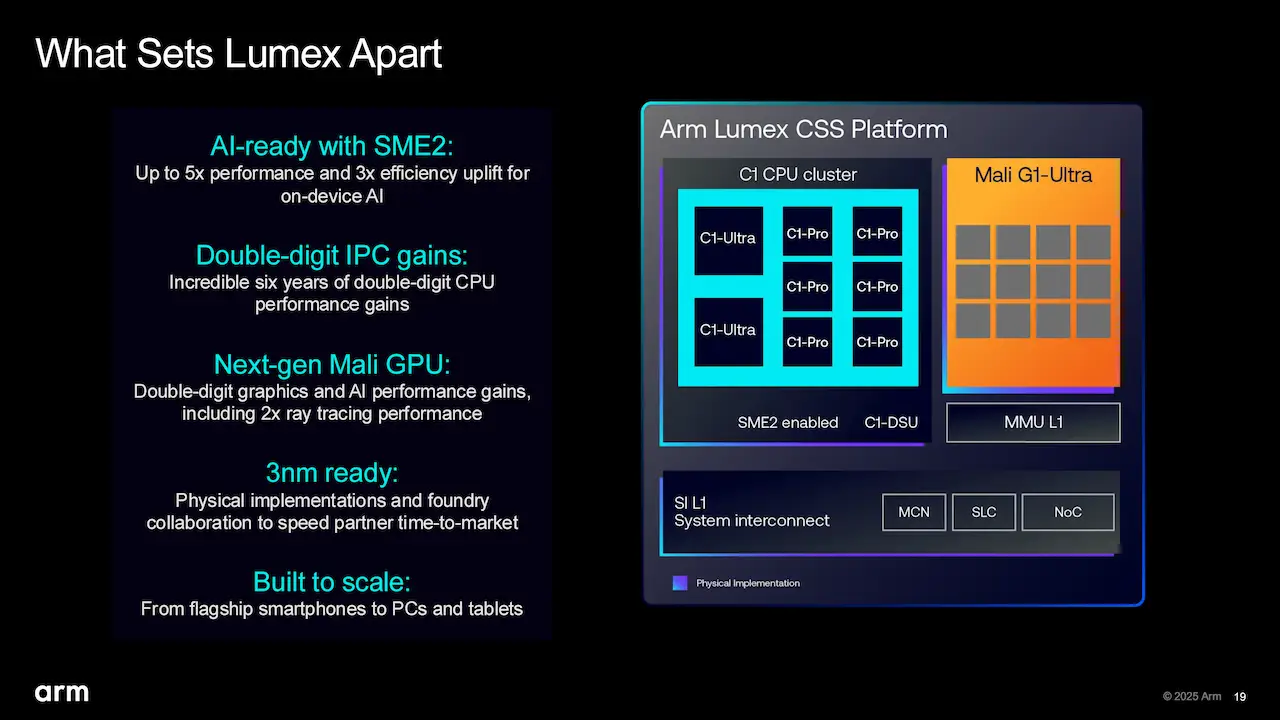

Lumex CSS 採用模組化設計,核心包括基於 Armv9.3 架構的 C1 系列 CPU 叢集,搭載 SME2 指令集,並針對不同需求推出 Ultra 、 Premium 、 Pro 、 Nano 與 Pico 等版本,讓製造商能依照市場區隔選擇最合適的方案。與此同時,Mali G1-Ultra GPU 也在這個平台中扮演關鍵角色,這款 GPU 支援第二代光線追蹤架構-RTU-V2,能大幅提升遊戲畫面算圖的即時效果,也為 AI 推論提供更多運算資源。配合 DynamIQ C1-DSU 設計,整個平台在效能、能效與彈性之間取得平衡。

SME2 的加入被視為這次平台升級的最大亮點。與前代相比,使用 CPU 進行 AI 推論效能最高可提升 5 倍,語音識別的延遲縮短近 5 倍,而音訊生成的速度則快上近 3 倍。這些改變使得許多過去必須依賴雲端進行的 AI 工作,現在能直接在裝置上完成,如即時語音翻譯、影像識別與生成式 AI 聊天等應用,都能在本地端獲得更低延遲的回應,並在隱私保護上帶來優勢。

除了效能的直接提升,SME2 也展現了在影音處理上的可能性。根據 Arm 提供的數據,在單一核心上即可完成影像降噪演算法,在 1080p 的條件下能達到每秒 120 格,4K 解析度則能維持每秒 30 格,顯示傳統 CPU 難以處理的任務,如今能藉由新指令集在裝置上完成,且不必仰賴獨立 GPU 或雲端運算。

談到 C1 處理器,這其實是過去的 Cortex A 與 Cortex X 處理器的延伸,徐達勇表示根據 Arm 的新策略-平台優先,在 Lumex 平台中統一命名為 C 系列處理器,因此第一代 Lumex 平台的處理器則稱之為 C1 處理器。

Arm 首席應用工程師胡岱勛表示新一代的 C1-Ultra 單執行緒性能比前代提升約 25%,而每周期指令數 (Instructions Per Cycle, IPC)已經連續第六年保持雙位數的成長。不同型號針對市場需求做出取捨,例如 Premium 版本透過縮小晶粒面積,降低製造成本,鎖定中高階市場;Pro 版本則針對長時間持續運算進行最佳化,提升效能穩定性;至於 Nano 版本則專為穿戴式裝置設計,能效比前代增加了超過 25% 。這些選項讓合作夥伴在設計產品時能靈活搭配。

在 GPU 方面,Mali G1-Ultra 的圖形效能相較前一代提升兩成,AI 推論速度也增加了相同比例,同時在能耗方面降低近一成。更重要的是,光線追蹤效能提升了兩倍,讓手機遊戲首次能夠接近桌機等級的即時光影表現。由於 GPU 採用了獨立電源島設計,在不需要光線追蹤時可以完全關閉相關電路,減少能耗,這對續航力有限的行動裝置尤其重要。

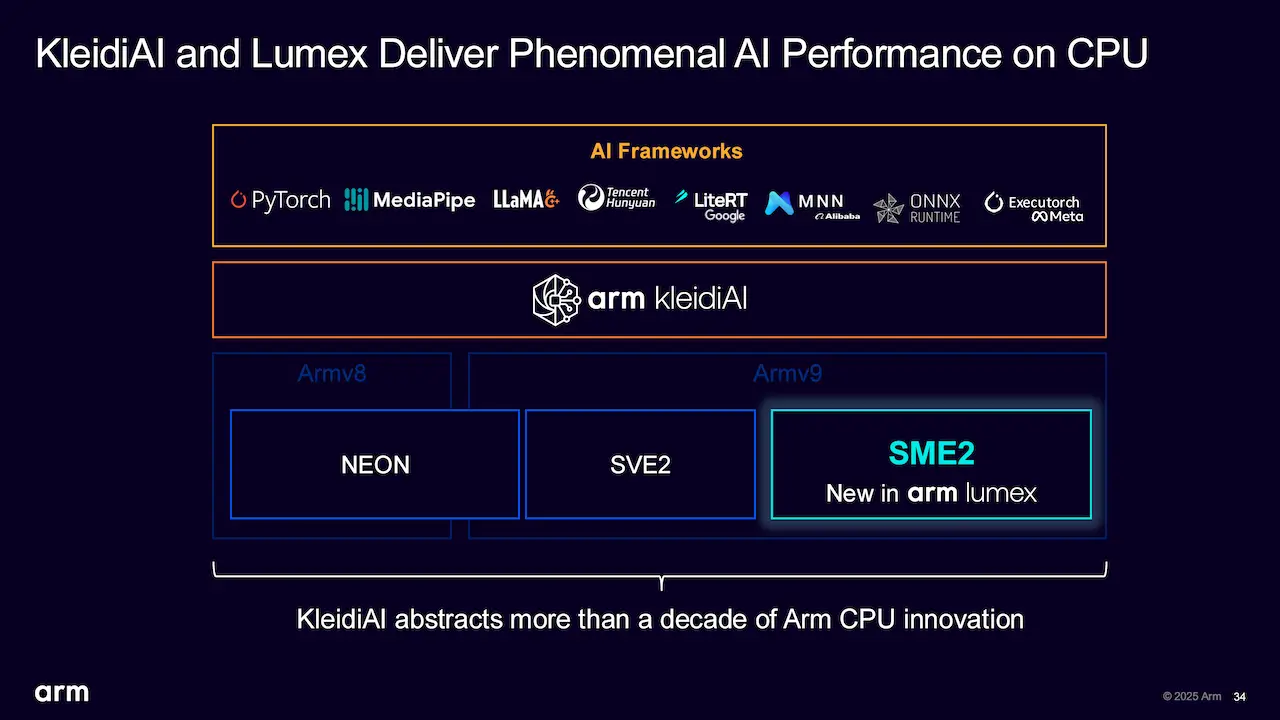

軟硬體整合創造生態系統

Arm 也特別強調了 Lumex 在 3nm 製程上的設計成熟度。過去合作夥伴在進入先進製程時,常面臨一次投片成功率低、風險高的問題,而這次平台已經針對 3nm 製程進行優化,提供可直接套用的參考設計,協助合作廠商降低風險,加速產品上市。軟體層面上,Lumex 平台搭載 Android 16 相容的堆疊,並整合 KleidiAI 函式庫以及主流的 AI 框架,包括 ONNX Runtime 與 PyTorch ExecuTorch,讓開發者不必修改程式碼,就能利用 SME2 提供的加速能力。

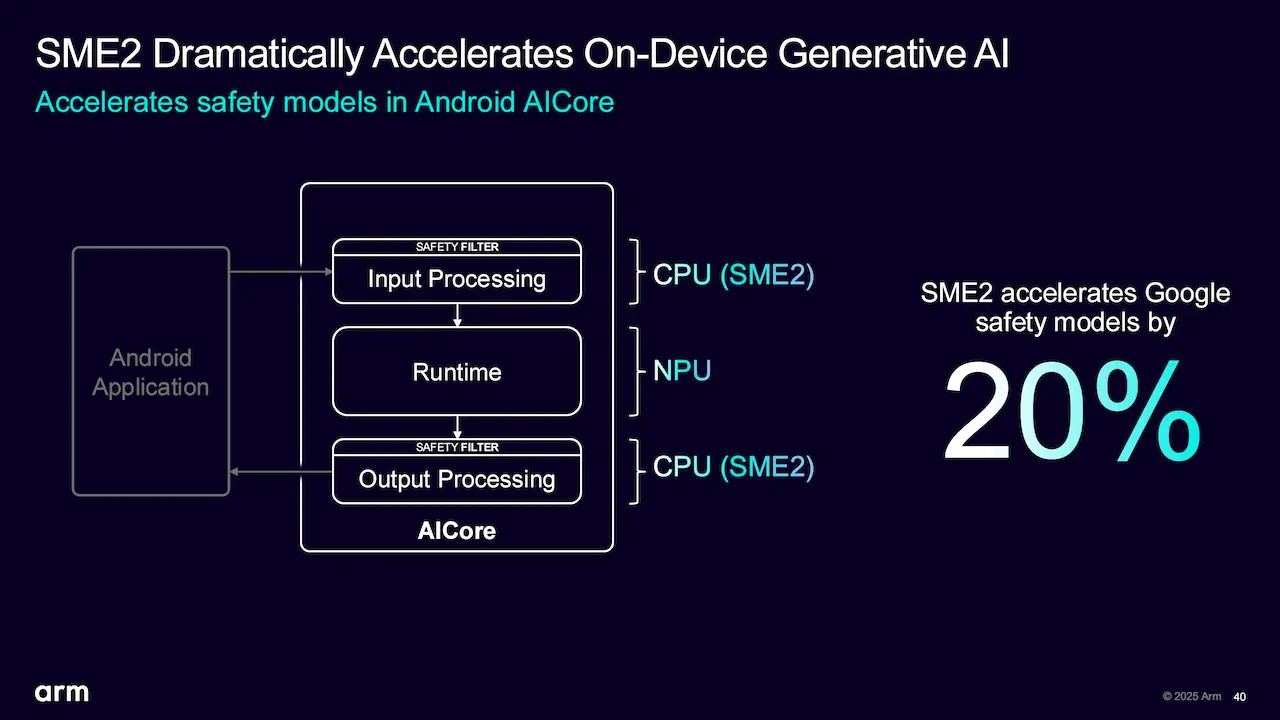

Arm 手機策略總監蔡武男表示 Google 的 AI Core 也開始跟 Arm 合作。過去 AI Core 如 Gemini Nano 都是跑在 NPU 上面,但前後連接的小模型則是跑在 CPU 上。 Google 採用 Arm SME2 技術之後,前後連接的小模型都可以加速 20% 。 Google 已經確認旗下應用如 Gmail 、 YouTube 與 Google 相簿都已相容,未來裝置上市後便能立即受惠。

目前已有多家廠商開始基於 Lumex 展開合作。三星與 Arm 正共同開發下一代旗艦處理器;聯發科則評估將 Lumex 技術導入自家行動 SoC 。支付寶在 vivo 的新機測試中,利用 SME2 驅動的 AI 引擎提升了 25 至 40% 的推理速度。阿里巴巴則將 SME2 整合進 MNN 框架,成功在手機端完成億級參數模型的推理運算。此外,Google 、 Meta 與騰訊等企業,也都在測試 Lumex 的 AI 加速能力。這些合作顯示,從晶片設計到應用服務,整個產業鏈正在以 Lumex 為基礎加速裝置端 AI 的部署。

整體來看,Lumex CSS 平台並不是單純的一次硬體升級,而是結合了 CPU 、 GPU 、系統 IP 、軟體堆疊與製程驗證的完整方案。它的目標不只是讓單一裝置效能提升,而是希望為 OEM 與開發者建立一個統一的基礎,縮短開發週期,並推動裝置端 AI 成為主流。在智慧型手機與個人電腦市場持續追求即時生成、個人化體驗與隱私保障的趨勢下,Arm 透過 Lumex 所提出的整合式解決方案,展現了它在裝置端 AI 戰場上的企圖心與長期戰略。