過去在邊緣跑 AI 功能的選擇,向來是以微型系統的 IoT 裝置為主要載體,複雜的運算則透過網路連線交給雲端主機運算。然而,當 Edge AI 的需求規模逐漸膨脹後,專屬微型系統的 IoT 裝置平台已無法負擔小型 LLM(或稱之為 SLM)的運作需求。

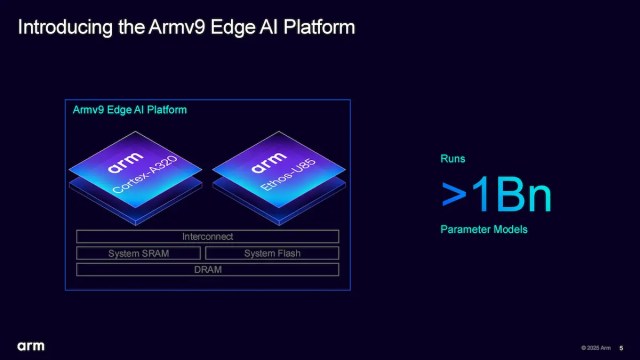

因此,Arm 正式推出全球第一款採用 Armv9 架構的邊緣 AI 運算平台,以全新的 Cortex-A320 CPU 與 Ethos-U85 NPU 為核心,專為物聯網 (IoT) 應用所打造,可支援超過 10 億參數的 AI 模型,甚至可達 50 億參數的規模,象徵專用型 AI 將從雲端下放到邊緣的關鍵轉折點。

目前 AWS 、西門子、瑞薩電子等業界龍頭已宣布支援該平台,Arm 主任應用工程師林宜均表示 Cortex-A320 預計將廣泛應用於智慧工廠、智慧相機、工業自動化等領域。

本文目錄

Cortex-A320 功耗大幅降低,效能可跑 LLM-5B

相較於前代 Cortex-A35,Cortex-A320 的機器學習效能提升 10 倍,CPU 效能增加 30%,並支援最新 V9.2 架構,最重要的是相較於 Cortex-A520 處理器,其功耗降低 50%,是 Cortex-A 系列處理器中最省電的產品。

Arm 應用工程總監徐達勇表示,過去使用行動專用處理器 Cortex-M85 跑 AI 時,由於內建記憶體容量及傳輸頻寬的限制,能夠跑的 AI 參數規模有限,屬於 Endpoint AI 產品線。而 Cortex-A320 優異的功耗表現,原先使用 Cortex-M85 的客戶,可以升級到 Cortex-A320,不僅適用於 Android 等功能豐富的作業系統,還全面支援即時作業系統 (RTOS) 如 FreeRTOS 和 Zephyr 來設計終端應用,邁入 Edge AI 的產品線。

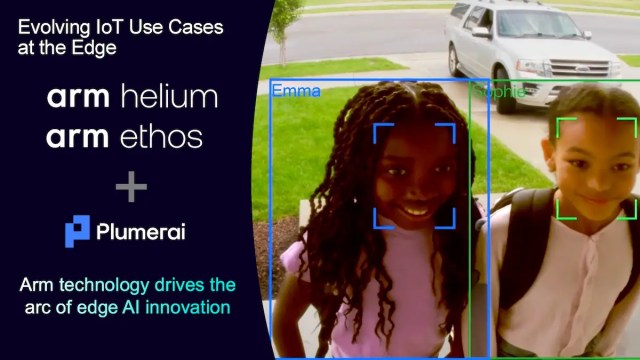

Arm 物聯網事業部亞太區資深經理黃晏祥表示國外有一款智慧電鈴,透過 Arm Edge AI 平台,能夠即時辨識門外人員的身分,並透過 LLM 產生適當的場景描述,例如是否有家人帶著陌生人,或是快遞送貨等場景,產生文字通知寄送給使用者。而這一切並不需要將影像資料送到雲端進行辨識,可滿足客戶對於高隱私及低延遲的要求。

黃晏祥表示:「Cortex-A320 支援更大的記憶體定址空間,為執行更大規模的 Edge AI LLM 提供可能性,搭配 Ethos-U85 NPU,支援 Transformer 演算法,相較於去年基於 Cortex-M85 的平台,新平台的機器學習效能提升 8 倍。」

Armv9.2 架構加持築起資安高牆

除此之外,黃晏祥也非常鼓勵客戶升級到 Armv9 架構,立即取得最新架構所提供的安全性,包括防止程式碼被惡意竄改的指標驗證 (PAC) 、提升執行流程安全性的分支目標識別 (BTI),以及保護記憶體免受漏洞攻擊的記憶體標籤擴充 (MTE),更支援 EL2 層級虛擬化和 BF16 資料格式,在兼顧安全性的同時,進一步提升 AI 運算效能。

林宜均表示,其實 Cortex-A320 處理器最常見的應用場景是伺服器和行動裝置,其中被採用的原因之一正是安全性,因此非常建議採用前一代 Armv8 架構產品的客戶,升級到 Armv9 架構,尤其是非常容易被當成跳板的 IoT 裝置,可考慮升級到更安全的 Cortex-A320 處理器。

Kleidi AI 加持,AI 效能大提升

ARM 將 Kleidi AI 運算庫延伸至物聯網,這是一套針對 AI 框架開發者的工具,無需額外操作即可優化基於 Arm CPU 的 AI 與 ML 工作負載。 Kleidi AI 已整合於 Llama.cpp 、 ExecuTorch 和 LiteRT(透過 XNNPACK)等框架,支援 Meta Llama 3 、 Phi-3 等模型。記者會數據顯示,在跑微軟 Tiny Stories 資料集時,Cortex-A320 搭配 Kleidi AI,可得到 70% 的效能提升。

但 Cortex-A320 搭配 Kleidi AI,跑小語言模型時,究竟能提供多快的 Token 輸出效能,Arm 目前沒有確切的測試數據,有待事後驗證。